Pour obtenir une belle image, un bon cadrage est essentiel. L’IA a tendance à centrer le sujet automatiquement, mais cela ne suffit pas toujours ! Il existe plusieurs types de prises de vue : Close-up, Extreme Close-up, POV, Medium Shot, Long Shot, etc., chacun apportant une esthétique et un focus différents.

Je vous propose de tester les effets de ces différents « types de prise de vue ». Le prompt de base sera le suivant : « An Alpine woman in the 1920s. Alpine mountains in background. »

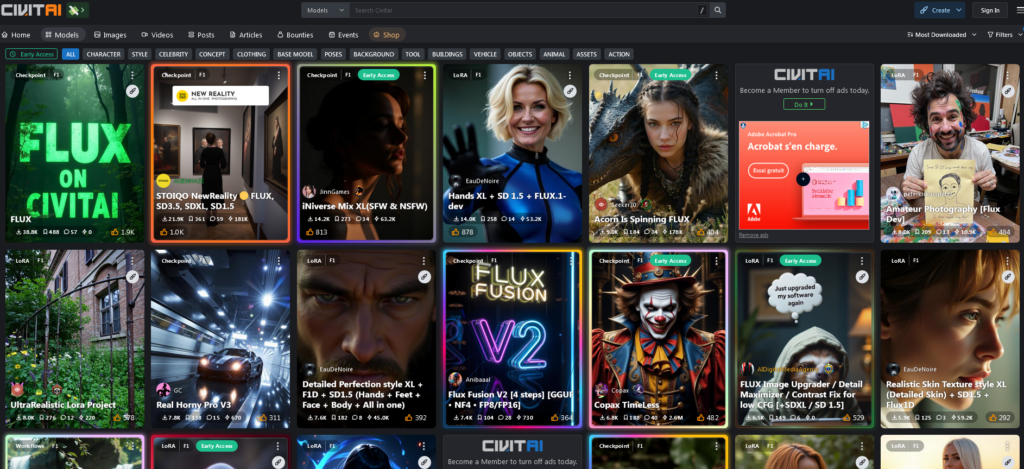

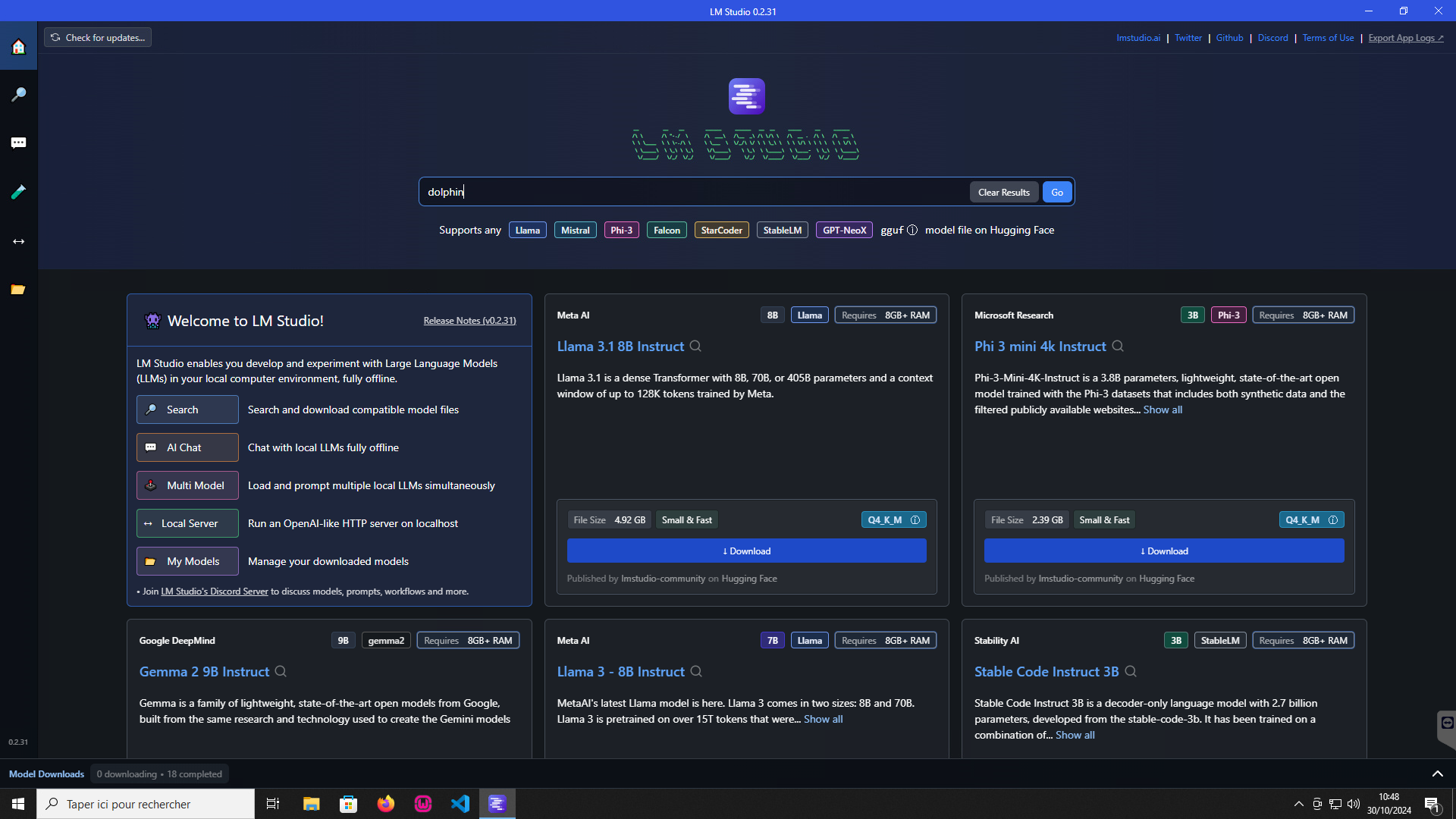

Les modèles utilisés seront FLUX et SDXL :

- Pour FLUX : Acorn is Spinning FLUX, en version De-Distilled.

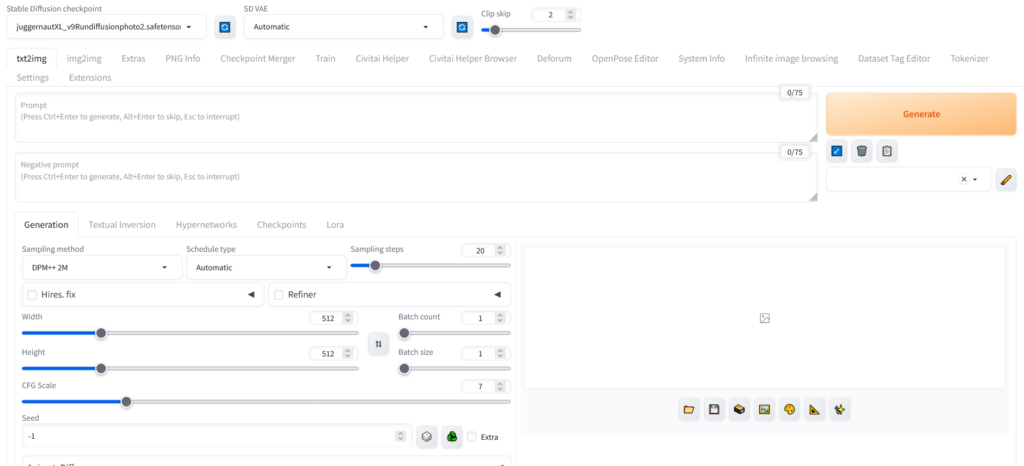

- Pour SDXL : JuggernautXL.

Notez que les modèles FLUX, bien que produisant des images de qualité, ne respectent pas toujours fidèlement les spécifications des prises de vue.

L’Extreme Close-up (Zoom) :

Prompt 1 : « Extreme close-up of an Alpine woman in the 1920s. Alpine mountains in background. »

Le Close-up (Gros plan / portrait) :

Prompt : « Close-up of an Alpine woman in the 1920s. Alpine mountains in background. »

Medium shot (hanches) :

Prompt : « Medium of an Alpine woman in the 1920s. Alpine mountains in background. »

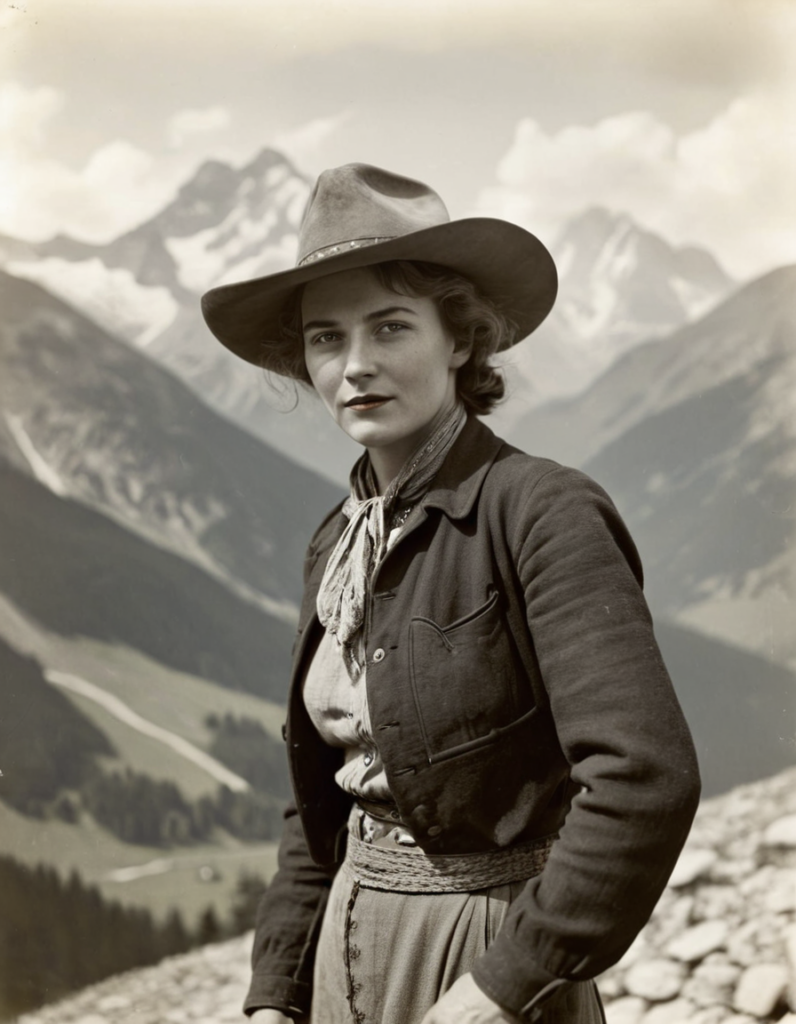

Cowboy shot (mi-cuisse):

Prompt : « Cowboy shot of an Alpine woman in the 1920s. Alpine mountains in background. »

Note : FLUX n’est pas bon pour ce terme. C’est une spécificité des modèles SD1.5 et SDXL. Plus que cela, il sort une femme « cowboy » … SDXL cadre correctement, mais ajoute aussi un chapeau de Cowboy…

Medium full shot :

Prompt : « Medium full shot of an Alpine woman in the 1920s. Alpine mountains in background. »

Full shot :

Prompt : « Full shot of an Alpine woman in the 1920s. Alpine mountains in background. »

Long shot :

Prompt : « Long shot of an Alpine woman in the 1920s. Alpine mountains in background. »

Conclusion

Les modèles d’IA ne respectent pas toujours parfaitement les contraintes de cadrage, mais il est essentiel de les inclure dans les prompts. En particulier, précisez au minimum un cadrage « full body » ou « portrait » pour obtenir des résultats proches de vos attentes.